AIが生成したバイラル画像は、現代のデジタル文化における顕著な現象となっています。このようなビジュアルは、従来のコンテンツよりもはるかに速く、数百万回の閲覧を集め、議論の波を引き起こし、新しいミームを形成します。AIが生成した画像は、目新しさ、感情、ソーシャルプラットフォームのアルゴリズムの交差点で機能します。なぜでしょうか?詳しく見ていきましょう。

人工知能は、画像の作成方法だけでなく、バイラル性の本質そのものをも変えました。かつては、何百万人もの人々に届くようなビジュアルを作成するには、予算、チーム、制作が必要でしたが、今日では、ジェネレーターに対する適切に組み立てられたリクエストで十分です。AIはクリエイターをミニスタジオに変え、制作速度を競争優位に変えました。

しかし、生成されたという事実だけでは、リーチは保証されません。ほとんどのAI画像は気づかれません。バイラルになるのは、文化的、感情的、または情報的なトリガーポイントに当たるものだけです。これは、現在の政治イベント、認識可能なポップカルチャーのキャラクター、懐かしいスタイル、または簡単にミームになる意図的な不条理である可能性があります。

もう1つの重要な特徴は、アルゴリズムによる増幅です。ソーシャルプラットフォームは、コメント、保存、再投稿などの迅速な反応を引き起こすコンテンツを推進します。AI画像は、ユーザーに立ち止まって「これは本物か?」または「どうやって作成したのか?」と尋ねさせるため、しばしばそのような反応を引き起こします。疑念、賞賛、または憤慨がインタラクションのトリガーになります。

同時に、AIビジュアルのバイラル性は、しばしば「超現実的なフィクション」の効果に基づいています。画像はもっともらしく見えますが、不可能なことを示しています。現実とファンタジーの間のこのギャップは、人々が議論し、共有したいと思う認知的不協和を生み出します。

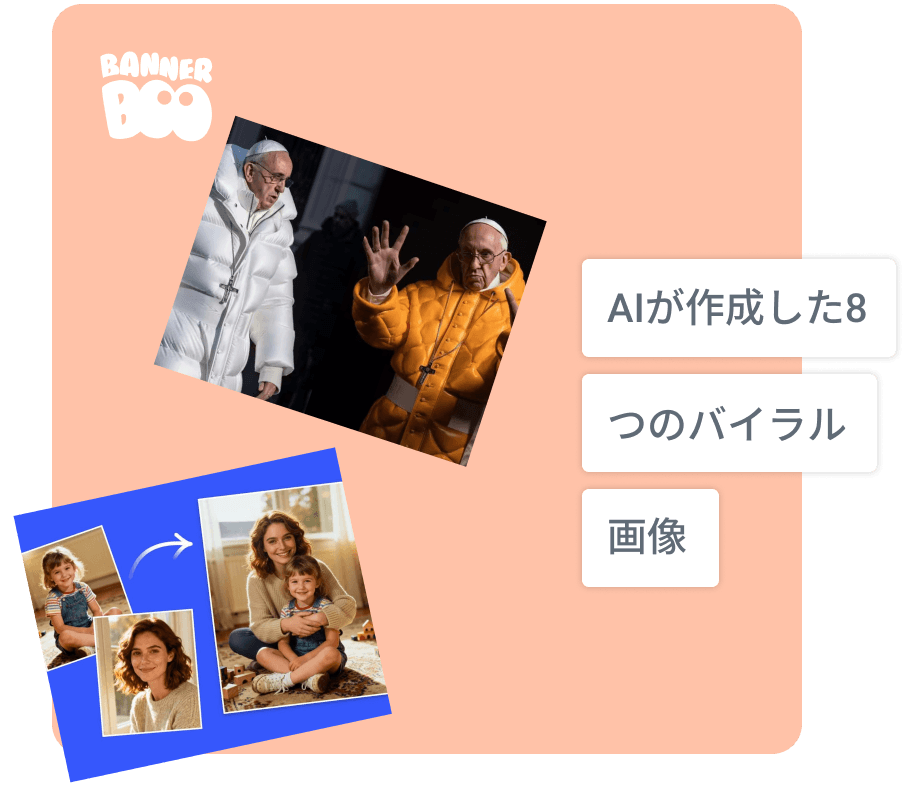

人工知能によって作成され、バイラルになった画像の具体的な例を見て、それぞれの場合にどのようなメカニズムが機能したかを分析しましょう。

AI画像のバイラル性は、偶然であることはほとんどありません。それぞれの話題の事例の背後には、文脈、感情的なトリガー、プラットフォームのアルゴリズムロジックの組み合わせがあります。それらのいくつかはミームになり、いくつかは社会的な議論の対象となり、いくつかはメディアの議題に影響を与えました。以下に、バイラルになったAI画像がどのように大規模なリーチを獲得したかを示すさまざまなシナリオを示す8つの例を示します。

内容:フランシスコがバレンシアガ風のおしゃれな白いダウンジャケットを着ているフォトリアルなAI画像。

バイラルになった場所:Twitter(現在のX)、後にInstagram、Reddit。

理由:神聖なイメージとファッションの美学の強いコントラスト(目新しさ)、軽い不条理、信憑性に疑問を抱かせたフォトリアリズム(感情的なトリガー)。最も議論された画像の1つ。

拡散の仕組み:画像の最初の投稿は、ミームアカウントやファッションコミュニティによってすぐに取り上げられました。ユーザーは「これは本物か?」という質問とともに積極的に再投稿し、大規模な議論の効果を生み出し、バイラル性を加速させました。

内容:ドナルド・トランプが逮捕されたかのような一連のAI画像。

バイラルになった場所:Twitter/Xおよびニュースメディア。

理由:政治的な関連性(文脈)、信憑性の錯覚を生み出したハイパーリアリズム、そして「もしこれが本当だったらどうなるだろう?」という効果(感情+情報的な反響)。

拡散の仕組み:画像は政治的なアカウントやニュースページを通じて拡散され、ユーザーは実際の出来事の可能性について議論しながら大量にリツイートしました。

内容:すぐにミームシリーズとなった、イタリア風の名前を持つ不条理なAIクリーチャー。

バイラルになった場所:TikTokとInstagram Reels。

理由:純粋な不条理、リミックスのしやすさ(ミーム性)、何千ものユーザーが取り上げたシリーズ性。

拡散の仕組み:ユーザーは独自のキャラクターバリエーションを作成し、トレンドを何千ものリミックスを持つ無限のミームチェーンに変えました。

内容:ユーザーは、幼少期の自分を抱きしめているAI画像を作成しました。

バイラルになった場所:Instagram (Reels, Stories)。

理由:ノスタルジー(感情)、パーソナライゼーション、シンプルな繰り返し可能なフォーマット(シリアル性)。

拡散の仕組み:ユーザーはフォーマットを大量に繰り返し、自分のバージョンを投稿し、友人をタグ付けして、コンテンツの連鎖反応を促しました。

内容:スタジオジブリの美学で作成された画像。

バイラルになった場所:TikTok、Instagram、X。

理由:ノスタルジー、認識可能なスタイル、感情的な温かさ、そして見慣れた世界で自分自身を「描き直す」という大衆の願望。

拡散の仕組み:ユーザーはアニメ風の自画像を大量に生成し、結果を共有することで、ユーザー生成コンテンツの波を生み出しました。

内容:AIによって作成され、ニュースレポートの写真のようにスタイライズされた、ペンタゴン付近の爆発のリアルな画像。

バイラルになった場所:X。画像はニュースを投稿するアカウントを通じて急速に拡散されました。

理由:緊急ニュース効果(文脈)、画像の高い信頼性、衝撃要因、情報アカウントを通じた迅速な拡散。

拡散の仕組み:ニュースアグリゲーターと「速報ニュース」アカウントが画像を取り上げ、その後、リツイートを通じて瞬く間に拡散されました。

内容:メットガラ2024でAIが生成したケイティ・ペリーのリアルな写真は、ポップスターが年間最大のイベントを欠席したにもかかわらず、バイラルになりました。

バイラルになった場所:メットガラ期間中のInstagramとX。

理由:時事的なイベント(文脈)、信憑性、「独占スクープ」効果(目新しさ)。

拡散の仕組み:ユーザーは写真を「レッドカーペットからのリーク」として拡散し、画像への関心を高めました。

内容:AIによって作成され、宇宙ミッションや望遠鏡の公式写真のようにスタイライズされた、宇宙、宇宙飛行士、銀河のリアルな画像。多くのユーザーは、これらを宇宙計画からの本物の写真として受け取りました。

バイラルになった場所:宇宙と科学に特化したコミュニティのInstagram、Reddit、X。

理由:視覚的な信頼性、宇宙機関の権威との関連付け、「珍しい宇宙写真」効果(目新しさ)。

拡散の仕組み:画像は科学および宇宙関連のパブリックアカウントで積極的に再投稿され、ユーザーは「ユニークな写真」として共有し、バイラル性を加速させました。

これらすべてのバイラルAI画像に共通しているのは、テクノロジーそのものではなく、トリガーです。それは、強い感情、文化的文脈、またはミームに簡単に拡大できる不条理です。バイラル性は、信頼性と予期せぬ出来事が組み合わさるところに現れます。このバランスこそが、アルゴリズムと大規模な拡散を起動させます。

バイラル性とは、コピーすることではありません。バイラルになったAI画像のほとんどは、スタイルそのものではなく、アイデア、文脈、提示方法によって機能しました。効果を再現することは可能ですが、他人のストーリーを再現するのではなく、同じメカニズム(対比、感情、不条理、関連性、プラットフォームに適したフォーマット)を使用します。

3つの重要な原則を次に示します。

ビジュアルをコピーしないでください。ロジックをコピーしてください。

対比(例えば、神聖なもの+ファッション)によって画像がバイラルになった場合、同じイメージを再現しないでください。あなたのニッチで別の文化的または社会的対比を見つけてください。

何をすべきか?

バイラル性は、コピーではなく解釈があるところに生まれます。

ほとんどのバイラルAI画像はシリーズに変換されました。なぜなら、1つの成功したビジュアルは衝動であり、シリーズは拡大だからです。

なぜこれが機能するのか?

何をすべきか?

シリーズは、単なるバイラル投稿ではなく、ミクロトレンドを形成します。

同じAIビジュアルでも、プラットフォームによって機能の仕方が異なります。

TikTok/Reelsにとって何が重要か?

Instagramにとって何が重要か?

X (Twitter)にとって何が重要か?

LinkedInにとって何が重要か?

バイラル性は、しばしば画像そのものではなく、そのパッケージ化方法に左右されます。

重要なアイデア:バイラルAI画像の成功を再現するには、特定のイメージをコピーする必要はありません。メカニズムを再現する必要があります。コントラストまたは感情、次に連続性、次にプラットフォームへの適応、最後にオーディエンスの関与です。

AIは単なるツールです。バイラル性は戦略によって生み出されます。

バイラル性は責任を免除しません。AI画像は急速にスケールアップする可能性がありますが、リーチの拡大とともに、評判、法的、倫理的なリスクも高まります。

考慮すべきことは何ですか?

画像が人工知能によって作成された場合、それは視聴者に明確であるべきです。「AIで作成」または「AI生成」などのラベルは、誤解を招くリスクを減らし、信頼を高めます。

許可なく公人のイメージを使用すると、特にコンテンツが誤解を招いたり評判を傷つけたりする場合、法的な結果が生じる可能性があります。ディープフェイクコンテンツは高リスクの領域です。

特定のアーティスト、スタジオ、またはブランドの認識可能なスタイルを模倣すると、知的財産に関する問題が生じる可能性があります。特定の視覚的な特徴をコピーするのではなく、独自のスタイルの解釈を作成する方が安全です。

存在しなかった出来事を模倣したフォトリアルなAI画像は、誤報を拡散する可能性があります。特に、政治、災害、戦争、社会的に敏感なテーマを扱う場合は注意が必要です。

ソーシャルネットワークは、AIコンテンツのラベリング要件を徐々に導入しています。違反すると、リーチの制限やアカウントのブロックにつながる可能性があります。

主要原則:AI画像が実際の事実として認識される可能性がある場合、それをラベル付けする必要があります。損害を与える可能性がある場合、それを公開すべきではありません。バイラル性は短期的ですが、視聴者の信頼は戦略的資産です。

人工知能によって作成されたバイラル画像は、単なる技術現象ではなく、コンテンツのエコシステム全体の変化を示すものです。AIはビジュアル制作の障壁を劇的に下げましたが、同時にアイデアに対する要求も高めました。誰もが「印象的な画像」を作成できるようになったとき、ツールではなくコンセプトが勝利します。

事例の分析は、バイラル性が3つの要因の交差点で生まれるというパターンを示しています。強力なトリガー(感情、不条理、恐怖、ノスタルジー)、時事的な文脈(ニュース、ポップカルチャー、社会問題)、そしてプラットフォームのアルゴリズムによる増幅です。いずれかの要素が欠けていると、スケールアップは起こりません。これが、ほとんどのAI画像が気づかれず、一部だけが文化的イベントになる理由です。

もう1つの重要な点は、「もっともらしいフィクション」の効果です。人々は、リアルに見えるが予期せぬことや不可能なことを示すコンテンツと相互作用する傾向があります。この認知的不協和は、立ち止まってよく見たり、コメントしたり、共有したりするきっかけとなります。デジタル環境では、まさにこのような反応がアルゴリズムを起動させます。

同時に、バイラル性はもはや純粋な創造的成果ではなく、危険になる可能性があります。したがって、AIビジュアルを扱う戦略は、創造的なテクニックだけでなく、倫理的枠組みと法的リスクの理解も含む必要があります。

したがって、人工知能は自動的にバイラル性を生み出すのではなく、制作を加速させるだけです。そして、創造的なアイデアは常に人気になります!