Virale Bilder, die von künstlicher Intelligenz erstellt wurden, sind zu einem bemerkenswerten Phänomen der modernen digitalen Kultur geworden. Solche Visuals erzielen Millionen von Aufrufen, lösen Diskussionswellen aus und bilden neue Memes deutlich schneller als herkömmlicher Inhalt. KI-generierte Bilder wirken an der Schnittstelle von Neuheit, Emotionalität und Algorithmen sozialer Plattformen. Warum? Sprechen wir genauer darüber.

Künstliche Intelligenz hat nicht nur die Art und Weise der Bildgestaltung verändert, sondern auch die Natur der Viralität selbst. Wenn früher für die Erstellung eines Visuals, das Millionen von Menschen erreichen konnte, ein Budget, ein Team und eine Produktion erforderlich waren, genügt heute eine korrekt formulierte Anfrage an einen Generator. KI hat den Kreativen in ein Mini-Studio verwandelt und die Produktionsgeschwindigkeit zu einem Wettbewerbsvorteil gemacht.

Doch der bloße Akt der Generierung garantiert noch keine Reichweite. Die meisten KI-Bilder bleiben unbemerkt. Viral werden nur jene, die einen Triggerpunkt treffen: kulturell, emotional oder informativ. Das kann ein aktuelles politisches Ereignis sein, eine bekannte Figur der Popkultur, ein nostalgischer Stil oder bewusster Unsinn, der sich leicht in ein Meme verwandelt.

Eine weitere wichtige Besonderheit ist die algorithmische Verstärkung. Soziale Plattformen fördern Inhalte, die eine schnelle Reaktion hervorrufen: Kommentare, Speichern, Reposts. KI-Bilder provozieren oft genau diese Reaktion, weil sie den Nutzer dazu bringen, innezuhalten und zu fragen: „Ist das echt?“ oder „Wie wurde das erstellt?“. Zweifel, Begeisterung oder Empörung werden zu einem Interaktionstrigger.

Gleichzeitig basiert die Viralität von KI-Visuals oft auf dem Effekt der „hyperrealistischen Fiktion“: wenn das Bild glaubwürdig aussieht, aber Unmögliches darstellt. Diese Diskrepanz zwischen Realität und Fantasie erzeugt eine kognitive Dissonanz, die Menschen diskutieren und verbreiten möchten.

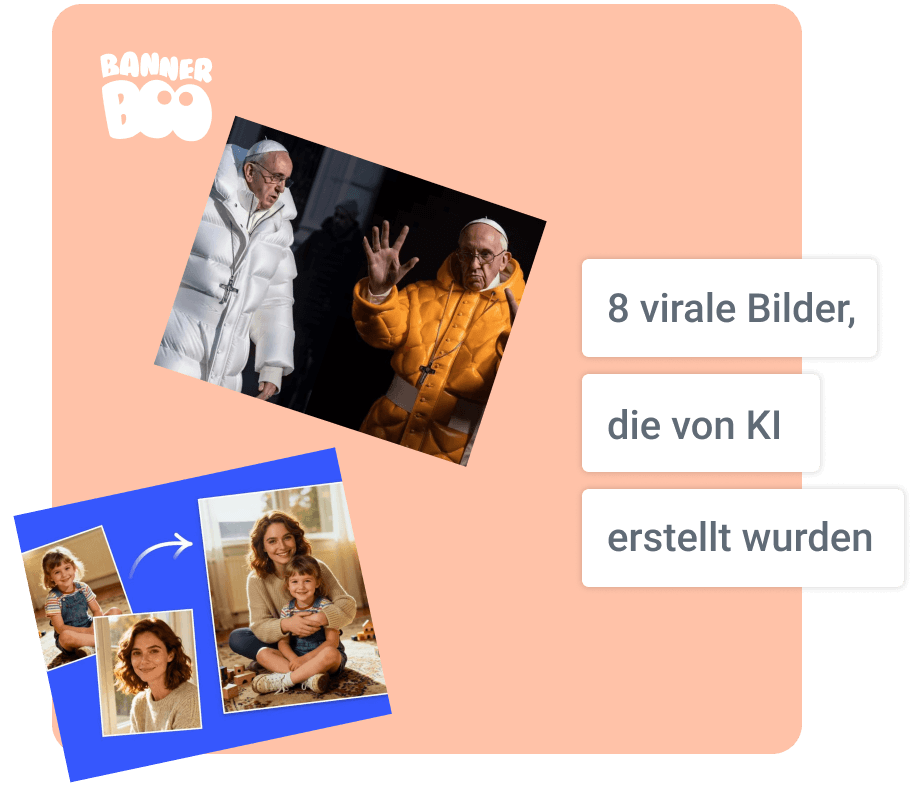

Betrachten wir konkrete Beispiele von durch künstliche Intelligenz erzeugten Bildern, die viral gegangen sind, und analysieren wir, welche Mechanismen in jedem Fall funktioniert haben.

Die Viralität von KI-Bildern ist fast nie zufällig. Hinter jedem aufsehenerregenden Fall steckt eine Kombination aus Kontext, emotionalem Trigger und der algorithmischen Logik der Plattform. Ein Teil davon wurde zu Memes, ein anderer Teil zum Gegenstand öffentlicher Diskussionen, und einige haben sogar die Medienagenda beeinflusst. Unten: acht Beispiele, die verschiedene Szenarien zeigen, wie virale KI-Bilder eine Massenreichweite erzielen.

Was es ist: Ein fotorealistisches KI-Bild, das Franziskus in einer modischen weißen Daunenjacke im Balenciaga-Stil zeigt.

Wo es viral ging: Die Plattform Twitter (jetzt X), später Instagram und Reddit.

Warum: Starker Kontrast zwischen sakralem Bild und Modeästhetik (Neuheit), leichter Absurdität, Fotorealismus, der Zweifel an der Authentizität weckte (emotionaler Trigger). Eines der am meisten diskutierten Bilder.

Verbreitungsmechanismus: Die ersten Posts des Bildes wurden schnell von Meme-Accounts und Fashion-Communities aufgegriffen; Nutzer teilten es aktiv mit der Frage „Ist das echt oder nicht?“, was einen Effekt der Massendiskussion erzeugte und die Viralität beschleunigte.

Was es ist: Eine Serie von KI-Bildern, die die angebliche Festnahme von Donald Trump zeigen.

Wo es viral ging: Twitter/X und Nachrichtenmedien.

Warum: Politische Relevanz (Kontext), Hyperrealismus, der die Illusion von Glaubwürdigkeit erzeugte, und der Effekt „was, wenn es wahr ist?“ (Emotion + Informationsresonanz).

Verbreitungsmechanismus: Die Bilder wurden über politische Konten und Nachrichtenseiten verbreitet; sie wurden massenhaft retweetet, wobei Nutzer die Möglichkeit eines realen Ereignisses diskutierten.

Was es ist: Absurde KI-Kreationen mit pseudo-italienischen Namen, die sich schnell zu einer Meme-Serie entwickelten.

Wo es viral ging: TikTok und Instagram Reels.

Warum: Reiner Absurdität, leichte Remixbarkeit (Memes), Serialität, die von Tausenden von Nutzern aufgegriffen wurde.

Verbreitungsmechanismus: Nutzer erstellten eigene Variationen der Charaktere, was den Trend in eine endlose Meme-Kette mit Tausenden von Remixen verwandelte.

Was es ist: Nutzer erstellten KI-Bilder, auf denen sie ihre kindliche Version umarmen.

Wo es viral ging: Instagram (Reels, Stories).

Warum: Nostalgie (Emotion), Personalisierung, einfaches, wiederholbares Format (Serialität).

Verbreitungsmechanismus: Nutzer wiederholten das Format massenhaft, veröffentlichten eigene Versionen und taggten Freunde, was eine Kettenreaktion von Inhalten auslöste.

Was es ist: Bilder, erstellt in der Ästhetik von Studio Ghibli.

Wo es viral ging: TikTok, Instagram, X.

Warum: Nostalgie, erkennbarer Stil, emotionale Wärme und der Massenwunsch, sich selbst in einem bekannten Universum „neu zu zeichnen“.

Verbreitungsmechanismus: Nutzer generierten massenhaft eigene Porträts im Anime-Stil und teilten die Ergebnisse, was eine Welle von nutzergenerierten Inhalten erzeugte.

Was es ist: Ein realistisches Bild einer Explosion in der Nähe des Pentagon-Gebäudes, erstellt von künstlicher Intelligenz und stilisiert als Foto aus einem Nachrichtenbericht.

Wo es viral ging: X, wo das Bild schnell über Konten verbreitet wurde, die Nachrichten veröffentlichen.

Warum: Effekt einer dringenden Nachricht (Kontext), hohe Glaubwürdigkeit des Bildes, Schockfaktor und schnelle Verbreitung über Informationskonten.

Verbreitungsmechanismus: Nachrichten-Aggregatoren und Konten mit „breaking news“ griffen das Bild auf, wonach es sich sofort durch Retweets verbreitete.

Was es ist: Ein realistisches Foto von Katy Perry, generiert von künstlicher Intelligenz bei der Met Gala 2024, wurde viral, obwohl der Popstar das Hauptereignis des Jahres verpasste.

Wo es viral ging: Instagram und X während der Met Gala.

Warum: Aktuelles Ereignis (Kontext), Glaubwürdigkeit, Effekt eines „exklusiven Fotos“ (Neuheit).

Verbreitungsmechanismus: Nutzer verbreiteten das Foto als angebliches „Leak vom roten Teppich“, was das Interesse am Bild verstärkte.

Was es ist: Realistische Bilder von Weltraum, Astronauten und Galaxien, erstellt von künstlicher Intelligenz und stilisiert als offizielle Aufnahmen von Weltraummissionen oder Teleskopen. Viele Nutzer hielten sie für echte Fotos aus Weltraumprogrammen.

Wo es viral ging: Instagram, Reddit und X in Communities, die sich Weltraum und Wissenschaft widmen.

Warum: Visuelle Glaubwürdigkeit, Assoziation mit der Autorität von Weltraumorganisationen, Effekt eines „seltenen Weltraumfotos“ (Neuheit).

Verbreitungsmechanismus: Die Bilder wurden aktiv in wissenschaftlichen und Weltraum-Blogs repostet, wo Nutzer sie als „einzigartige Aufnahmen“ teilten, was ihre Viralität beschleunigte.

Alle diese viralen KI-Bilder verbindet nicht die Technologie als solche, sondern ein Trigger: eine starke Emotion, kultureller Kontext oder Absurdität, die sich leicht zu einem Meme skalieren lässt. Viralität entsteht dort, wo Glaubwürdigkeit und Unerwartetes zusammentreffen. Genau dieses Gleichgewicht startet Algorithmen und Massenverbreitung.

Viralität bedeutet nicht Kopieren. Die meisten KI-Bilder, die viral wurden, funktionierten nicht wegen des Stils selbst, sondern wegen der Idee, des Kontexts und der Art der Präsentation. Den Effekt kann man wiederholen, aber nicht, indem man eine fremde Geschichte reproduziert, sondern indem man dieselben Mechanismen nutzt: Kontrast, Emotion, Absurdität, Aktualität und das richtige Format für die Plattform.

Hier sind drei Schlüsselprinzipien.

Kopieren Sie nicht das Visuelle – kopieren Sie die Logik.

Wenn ein Bild durch Kontrast viral wurde (z.B. sakral + Fashion), reproduzieren Sie nicht dasselbe Bild. Finden Sie einen anderen kulturellen oder sozialen Kontrast in Ihrer Nische.

Was ist zu tun?

Viralität entsteht dort, wo es Interpretation gibt, nicht Kopie.

Die meisten viralen KI-Bilder entwickelten sich zu einer Serie. Denn ein gelungenes Visual ist ein Impuls, eine Serie ist Skalierung.

Warum funktioniert das?

Was ist zu tun?

Eine Serie bildet nicht nur einen viralen Post, sondern einen Mikrotrend.

Ein und dasselbe KI-Visual funktioniert je nach Plattform unterschiedlich.

Was ist wichtig für TikTok / Reels?

Was ist wichtig für Instagram?

Was ist wichtig für X (Twitter)?

Was ist wichtig für LinkedIn?

Viralität hängt oft nicht vom Bild ab, sondern von der Art seiner Verpackung.

Kernidee: Um den Erfolg viraler KI-Bilder zu wiederholen, muss man nicht ein konkretes Bild kopieren. Man muss die Mechanik reproduzieren: Kontrast oder Emotion, dann – Serialität, dann – Anpassung an Plattformen und schließlich – Einbindung des Publikums.

KI ist nur ein Werkzeug. Viralität entsteht durch Strategie.

Viralität entbindet nicht von Verantwortung. KI-Bilder können sich schnell verbreiten, aber mit der Reichweite steigen auch die Reputations-, Rechts- und Ethikrisiken.

Worauf sollte man achten?

Wenn ein Bild von künstlicher Intelligenz erstellt wurde – sollte dies für das Publikum klar sein. Kennzeichnungen wie „mit KI erstellt“ oder „AI-generiert“ verringern das Risiko der Irreführung und erhöhen das Vertrauen.

Die Verwendung von Bildern öffentlicher Personen ohne Genehmigung kann rechtliche Konsequenzen nach sich ziehen, insbesondere wenn der Inhalt irreführend ist oder den Ruf schädigt. Deepfake-Inhalte sind ein Bereich erhöhten Risikos.

Die Nachahmung des erkennbaren Stils eines bestimmten Künstlers, Studios oder einer Marke kann Fragen bezüglich des geistigen Eigentums aufwerfen. Es ist sicherer, eine eigene Interpretation des Stils zu erstellen, anstatt eine spezifische visuelle Handschrift zu kopieren.

Fotorealistische KI-Bilder, die Ereignisse imitieren, die nicht stattgefunden haben, können Desinformation verbreiten. Besonders vorsichtig sollte man bei Themen wie Politik, Katastrophen, Kriegsereignissen und sozial sensiblen Themen vorgehen.

Soziale Netzwerke führen schrittweise Anforderungen an die Kennzeichnung von KI-Inhalten ein. Verstöße können zu einer Einschränkung der Reichweite oder zur Sperrung des Kontos führen.

Grundprinzip: Wenn ein KI-Bild als reale Tatsache wahrgenommen werden kann – muss es gekennzeichnet werden. Wenn es Schaden anrichten kann – sollte es nicht veröffentlicht werden. Viralität ist kurzfristig, aber das Vertrauen des Publikums ist ein strategisches Gut.

Virale Bilder, die von künstlicher Intelligenz erstellt wurden, sind nicht nur ein technologisches Phänomen, sondern ein Indikator für eine Veränderung des gesamten Content-Ökosystems. KI hat die Barriere der visuellen Produktion radikal gesenkt, aber gleichzeitig die Anforderungen an die Idee erhöht. Wenn jeder ein „beeindruckendes Bild“ erstellen kann, gewinnt nicht das Werkzeug, sondern das Konzept.

Die Analyse von Fällen zeigt eine Gesetzmäßigkeit: Viralität entsteht an der Schnittstelle von drei Faktoren: einem starken Trigger (Emotion, Absurdität, Angst, Nostalgie), einem relevanten Kontext (Nachrichten, Popkultur, soziale Themen) und der algorithmischen Verstärkung der Plattform. Fällt auch nur ein Element weg, kommt es zu keiner Skalierung. Deshalb bleiben die meisten KI-Bilder unbemerkt, und nur einzelne – werden zu kulturellen Ereignissen.

Ein weiterer wichtiger Punkt ist der Effekt der „glaubwürdigen Fiktion“. Menschen neigen dazu, mit Inhalten zu interagieren, die realistisch aussehen, aber etwas Unerwartetes oder Unmögliches darstellen. Diese kognitive Diskrepanz zwingt zum Innehalten, genauer Hinsehen, Kommentieren, Teilen. Im digitalen Umfeld löst genau diese Reaktion die Algorithmen aus.

Gleichzeitig ist Viralität nicht mehr nur eine rein kreative Leistung, sie kann auch gefährlich werden. Daher muss die Strategie für die Arbeit mit KI-Visuals nicht nur die kreative Technik umfassen, sondern auch einen ethischen Rahmen und das Verständnis rechtlicher Risiken.

Die künstliche Intelligenz erzeugt also nicht automatisch Viralität, sie beschleunigt lediglich die Produktion. Und kreative Ideen werden immer populär!